/*** Im Februar habe ich einen Vortrag bei der Tagung „Diskurs der Daten“ an der Uni Leipzig gehalten, dessen Verschriftlichung ich hier nun endlich veröffentliche. ***/

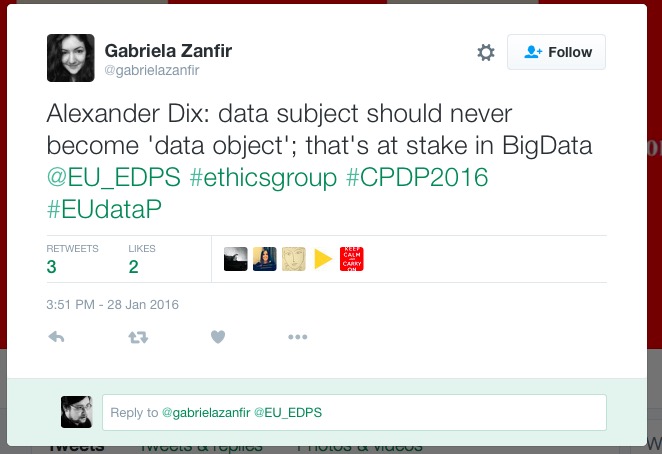

Auf der so genannten Computers, Privacy & Data Protection-Konferenz (CPDP2016)1 im Januar 2016 in Brüssel gab Alexander Dix, scheidender Datenschutzbeauftragter des Landes Berlin anscheinend folgendes von sich:

Das klingt erst mal gut, aufrüttelnd und irgendwie moralisch richtig. Bis man sich mit der Frage befasst, was denn das eigentlich sein soll, ein „Data Object“.

Dazu ein Beispiel: Das Zitat fand seinen Weg zu mir in Form eines Tweets. Nicht aber eines Tweets von Alexander Dix. So weit ich weiß, benutzt er kein Twitter. Er ist in diesem Fall also selbst kein „Data Subject“. Der Tweet stammt viel mehr von Gabriela Zanfir, einer Mitarbeiterin beim EDPS. Sie zitiert Alexander Dix hier namentlich. Die Frage scheint mir also offensichtlich: Ist hier etwa Alexander Dix, ohne überhaupt Data Subject sein zu müssen, zu einem „Data Object“ geworden? Und führe ich diese Dataobjektivizierung durch das digitale Zitieren dieses Tweets nicht noch fort und erweitere die Datenobjektsammlung damit wiederum um Gabriela Zanfir selbst?

Objektifizierung. Überall. Schlimm!

So geht das die ganze Zeit. Die Rhetorik ist alarmistisch, die Geschehnisse banal. Irgendwas stimmt mit diesem ganzen Datenschutz-Diskurs nicht. Wir alle sind in unzähligen Datenbanken verzeichnet und werden dort immer wieder der einen oder andern Datenverarbeitung unterworfen. Niemand kann von sich behaupten _kein_ Datenobjekt zu sein und dennoch malen wir es als Horrorszenario an die Wand. Was genau ist hier also „at stake“?

Ich glaube, es gibt in der westlichen Welt kaum ein Thema, über das unehrlicher gesprochen wird, als über Datenschutz. Und – um an dieser Stelle Alexander Dix auch zu verteidigen (den ich eigentlich sehr schätze) – das liegt nicht einfach an den einzelnen Protagonist/innen dieses Diskurses. Die Lüge besteht aus einem ganzen System unhinterfragter Annahmen und Behauptungen, die sich im Laufe der Zeit zu einer Ideologie sedimentiert und einer kollektiven Illusion tradiert haben. Nur hier und da erkennt man die „Glitches“, also die Stellen, wo die Lüge unmißverständlich aufblitzt und in kurzen Momenten mit einer Klarheit droht, das ganze System zum Einsturz zu bringen könnte. Die Aussage von Dix ist so ein Glitch. Es gibt aber ungleich größere.

Der Fall des Safe-Harbor-Abkommens2 kann gut und gerne als das Ground Zero dieses Systems verstanden werden und in seinen Trümmern lässt es sich gut studieren. Wir erinnern uns: Das Safe-Harbor-Abkommen bestand im Grunde aus der Behauptung, Unternehmen in den USA würden ihr Handeln dem Niveau europäischer Datenschutzbestimmungen unterwerfen. Dafür mussten sich Unternehmen ungeprüft zertifizieren lassen und schon war die Behauptung rechtskräftig. Also wahr. Auf so ne Art.

Die Episode erinnerte sehr an Hans Christian Andersens bekanntes Märchen: Des Kaisers neue Kleider. Dem Kaiser wird von einem Scharlatan ein Gewand aus dünnstem Stoff aufgeschwatzt, dass es in Wirklichkeit gar nicht gibt. Die Leichtigkeit dieses Nichts wurde dem Herrscher alsbald als Tragekomfort angepriesen und die Tatsache, dass er nichts an hatte, schlicht geleugnet. Aufgrund einer sozial induzierten kognitiven Dissonanz traut sich niemand bei Hofe darauf hinzuweisen, dass der Kaiser ja eigentlich nackt ist. Erst als er mit dem nichtvorhandenen Kleid in die Öffentlichkeit tritt, ruft ein Kind die Wahrheit: „Der hat ja gar nichts an!“, woraufhin alle anderen sich ebenfalls trauen das Offensichtliche auszusprechen.

Max Schrems hieß das Kind in unserem Fall. Er hatte es in einem Musterprozess gegen Facebook bis zum EuGH geschafft, welches mit Schrems feststellte, dass das Safe Harbor-Abkommen schon immer nackt war, dass die Behauptung die Unwahrheit war und überhaupt alles eine große Lüge. Pfui! Böse, USA!

Schrems wiederum bezog sich in seiner Argumentation auf ein anderes rufendes Kind: Edward Snowden. Der hatte gezeigt, dass US-Unternehmen nicht ohne Kooperation und/oder heimlicher – sogar illegaler – Bespitzelung von den dortigen Geheimdiensten arbeiten könnten. Damit war die Nacktheit des Kaisers bewiesen und konnte selbst von noch so rhetorisch geschickten Anwälten nicht mehr bestritten werden.

Weil es aber auch für Selbstverständlichkeiten wie der Tatsche, dass das Internet nun mal bis nach Amerika reicht, eine Rechtsgrundlage braucht, machten sich Juristen und Politiker sogleich daran einen Safe Harbor-Nachfolger zu konstruieren. Das neue Kleid heißt nun Privacy Shield, doch jenseits der aufgerüsteten Rhetorik (weg von der weltläufigen Offenheit des Hafens hin zur militaristischen Logik einer Defensivwaffe) hatte sich am Tragekomfort des neuen Kleides verdächtig wenig geändert.

Viele glauben, dass auch das Privacy-Shield einer juristischen Prüfung nicht stand halten werde. Max Schrems selbst hat mehrmals angemerkt, dass ein gültiges Abkommen unter der Prämisse der allgemeinen Geheimdienstüberwachung gar nicht möglich sei.3 Wie solle denn ein Bürger/eine Bürgerin noch eine „informierte Zustimmung“ zur Datenverarbeitung geben, wenn denn prinzipiell unwissbar sei, wer dann auf die Daten Zugriff habe und was dieser jemand dann damit anstelle? So lange eine solche geheimdienstliche Praxis vorherrsche, könne eigentlich eine rechtliche Grundlage für ein solches Abkommen gar nicht im Bereich des Möglichen liegen.

Interessant wird es, wenn man dieses Argument weiterdenkt. Auf die Frage, ob denn dann in Europa die Rechtsgrundlage für Datenverarbeitung in diesem Sinne nicht ebenfalls fraglich ist, da ja auch hier Geheimdienste nachgewiesener Maßen geheime Dinge mit den hier gespeicherten Daten machen, bejaht Max Schrems durchaus. Glücklicher Weise gibt es hier kein Abkommen, dass in Frage stehen würde. In den eigenen vier Wänden darf der Kaiser natürlich nackt rumlaufen.

Man kann das noch weiterspinnen, wie ich es ja bereits seit einigen Jahren tue 4: Wenn wir 1. nicht mehr kontrollieren können, welche Daten über uns an welchen Stellen gesammelt werden, weil wir die ganze Welt mit immer mehr und immer unsichtbareren Sensoren ausstatten;

Wenn wir 2. die Kapazitäten von Leitungen und Datenträgern immer weiter erhöhen, so dass Daten in immer größerem Umfang immer problemloser von A nach B kopiert werden können;

Wenn wir 3. immer bessere Methoden und Software zur Datenauswertung bereitstellen, die noch aus den unschuldigsten Daten komplexe Profilbildungen und unvorhergesehene Erkenntnisse erlauben;

Wenn wir also den informationellen Kontrollverlust auf den Ebenen der Sammlung, Speicherung und Auswertung erleben, wie können wir dann überhaupt noch – egal wo – von einer „informierten Einwilligung“ sprechen, ohne uns in die eigene Tasche zu lügen?

Und hier nähern wir uns endlich dem Kern des Systems aus Lügen: der „Informationellen Selbstbestimmung“5. Die Idee, dass ich das Recht habe zu kontrollieren, wer etwas über mich weiß und was er mit diesem Wissen anstellt, mag in den 80er Jahren eine kühne Utopie gewesen sein, heute ist sie ein gefährliches, niemals einzulösendes Versprechen, das – weil es niemals zugeben darf, eine Lüge zu sein – immer weitere Lügen gebiert.

Seien wir das Kind und sprechen es aus: die Illusion der „Informationellen Selbstbestimmung“ konnte nur deswegen funktionieren, weil wir alle mitgelogen haben und auch heute bereit sind jederzeit zu lügen. Jedesmal, wenn wir „Ok“ oder „Ich habe verstanden“ bei den unzähligen Terms of Service, Allgemeinen Geschäftsbedingungen und Datenschutzbelehrungen geklickt haben, aber in Wirklichkeit nicht das Gefühl hatten, wirklich zu wissen, was da mit unseren Daten geschieht, haben wir mitgeholfen diese kollektive Fiktion am Leben zu erhalten. Unsere Lügen haben sich akkumuliert zu einem System der Unehrlichkeit, in der die eine Lüge die andere Lüge deckte und als Wahrheit verifizierte. Und nun stehen wir auf unserem eigenen Lügenberg und übersehen von dort die Trümmer von Safe Harbor, welches doch auch nur eine weitere Lüge war. Und wir lachen. Worüber lachen wir eigentlich?

Ganz konkret: Wem bringt der Fall von Safe Harbor denn jetzt irgendwas? Also mehr Sicherheit? Mehr Schutz? Irgendwelche sonstigen Vorteile?

Die Antwort ist: Niemandem. Irgendetwas. Also bis auf die Deutsche Telekom, für die die Rechtsunsicherheit amerikanischer Serverbetreiber einen riesigen anstrengungslosen Reibach bedeutet.

In Wirklichkeit ist der Fall von Safe Harbor vergleichbar mit dem Platzen der Kreditblase von 2008. Es wird bis heute fälschlicher Weise behauptet, damals seien Werte vernichtet worden. Das stimmt nicht. Der Wert war nie da, er war immer nur behauptet. Genau so wie der „Schutz“ durch Safe Harbor immer nur behauptet war. Durch den Wegfall von Safe Harbor ist niemand mehr oder weniger geschützt. Und egal wie das neue Abkommen aussehen wird, der Schutz wird sich nicht wesentlich verschlechtern oder verbessern. All das sind nur Schattenboxkämpfe von Politiker/innen und Jurist/innen.

Mein Eindruck ist mittlerweile, dass die verbissene Verteidigung der Informationellen Selbstbestimmung einer Implementierung von tatsächlichem Schutz für Individuen im Weg steht. Wir sollten aufhören, darüber zu streiten, wie wir ein fiktives Recht bewerkstelligen können und anfangen zu fragen, welche Probleme sich denn nun aus Datenhaltung und -Verarbeitung konkret für Menschen ergeben.

Unser Motto sollte sein: Schützt die Menschen, nicht die Daten. Und das geht nur, wenn man sich von dem Konzept der Informationellen Selbstbestimmung endlich verabschiedet.

Es gibt da durchaus Ansätze das zu tun. Hans-Peter Bull, erster Bundesdatenschutzbeauftragter Deutschlands sieht das Konzept der informationellen Selbstbestimmung ebenfalls am Ende6. Niko Härting wirbt mit der Neuausrichtung des Datenschutzes anhand eines risikobasierten Ansatzes.7

Ich denke, diese Ansätze gehen in die richtige Richtung. Es gibt unterschiedliche Gefahren durch unterschiedliche Daten für unterschiedliche Menschen. Was für den einen eine Gefahr ist, ist für den anderen kein Problem. Ich will deswegen auf einer etwas abstrakteren Ebene einiger der Gefahren aufzeigen:

1. Diskriminierung (Institutionelle und auch alltägliche)

2. Manipulation (bishin zu handfester Erpressung)

3. Staatliche Willkür (zb. Cherrypicking von Daten zur Konstruktion von Evidenz)

4. Kriminalität (Identitätsdiebstahl bis Stalking)

5. Entwürdigende Bloßstellung (Public Shaming)

Wenn wir diese Probleme in den Vordergrund stellen wird schnell klar, dass Datenschutz oft nur eine sehr schlechte Antwort auf die Herausforderungen der digitalisierten Welt ist. Es gibt bessere Ansätze: Diskrimierungsverbote, demokratische Kontrollinstanzen, Kompetenzbeschneidung von Behörden, mehr Transparenzanforderungen, auch für Unternehmen, etc. Klar. Das sind alles nur Flicken. Das ist nicht ein schön in einem Stück gefertigtes Kleidchen und der Tragekomfort ist nicht so toll, wie bei der luftig leichten informationellen Selbstbestimmung.

Aber wir könnten alle wieder ein bisschen ehrlicher sein und ich bin fest überzeugt, dass das Schutzniveau unterm Strich steigen würde.

- CPDP http://www.cpdpconferences.org ↩

- Holland, Martin: Datenschutz bei Facebook & Co.: EuGH erklärt Safe Harbor für ungültig, http://www.heise.de/newsticker/meldung/Datenschutz-bei-Facebook-Co-EuGH-erklaert-Safe-Harbor-fuer-ungueltig-2838025.html (06.10.2015) ↩

- Vgl.: Armasu, Lucian: Max Schrems Provides In-depth Analysis Of Safe Harbor Ruling, http://www.tomshardware.com/news/max-schrems-post-safe-harbor,30343.html (16.102015) ↩

- In diesem Blog oder Seemann, Michael: Das Neue Spiel – Strategien für die Welt nach dem digitalen Kontrollverlust, Berlin: iRights Media 2014, S. 8. ↩

- Vgl. Recht auf Informationelle Selbstbestimmung: http://www.grundrechteschutz.de/gg/recht-auf-informationelle-selbstbestimmung-272. ↩

- Bull. Hans-Peter: Informationelle Selbstbestimmung – Visionoder Illusion? https://www.mohr.de/buch/informationelle-selbstbestimmung-vision-oder-illusion-9783161509056?createPdf=true. ↩

- Härting, Niko: Vom Verbotsprinzip zur Risikoorientierung, http://www.haerting.de/de/neuigkeit/vom-verbotsprinzip-zur-risikoorientierung ↩

Pingback: Sanktionsfrei ins Neue Spiel | H I E R

Pingback: die ennomane » Links der Woche

Pingback: Ethik und Big Data - (k)ein Widerspruch?! (Teil 2/3)

Pingback: Ethik und Big Data - (k)ein Widerspruch?! (Teil 3/3)

Pingback: Frisch gedruckt: Diskurs der Daten | H I E R

Pingback: Ethik und Big Data - (k)ein Widerspruch?! (Teil 3/3)